AIシステム開発企業様

使用用途

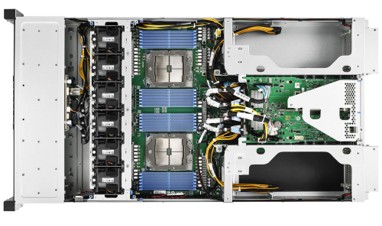

AIを活用した医療システム開発用にGPUサーバを導入頂きました。GPU単独のパフォーマンスを重視し、 NVIDIA RTX PRO 6000 Blackwell Workstation Edition Retail 96GB GDDR7 ECC(DisplayPort ×4)を搭載、更に同じGPUを追加出来る構成にて今後を見据えての展開となります。

参考価格

250万円

導入ワークステーション

| プリインストールOS | Ubuntu22.04LTS & CUDA12 インストール | |

|---|---|---|

| フレームワークス | NVIDIA GPU Cloud(TensorFlow/Pytorch)インストール | |

| シャーシー | 4U 1S 4th Gen AMD EPYC AI Server D831 x W438 x H176mm | |

| 冷却FAN | [標準] システム内部冷却用FAN 合計5基 8038Easy-Swap chassis fans | |

| CPU | AMD EPYC™ 9135 16C/32T 3.65 GHz(最大 4.3 GHz) 64 MB DDR5-6000 TDP=200W | |

| CPUクーラー | 液冷 4U Liquid cooling module for max. 500W CPU (x1) | |

| マザーボード | 標準 MSI MS-S337 4th Gen AMD EPYC9004 Processors | |

| チップセット | System On Chip 最大3TB 12-channel DIMM slots CPUTDP:Max up to 400W | |

| メインメモリ | 64GB (16GB×4) DDR5-5600 1.2V 1RANK Registered ECC DIMM | |

| SSD OS起動用 | 3.84TB U.3 NVMe MTBF=200万時間 エンタープライズSSD | |

| 内蔵グラフィック | [オンボード] ASPEED AST2600 BMC 64MB (VGAx1) | |

| GPUカード | 【1GPU】 NVIDIA RTX PRO 6000 Blackwell Workstation Edition Retail 96GB GDDR7 ECC(DisplayPort ×4) PCI-E5.0x16 | |

| LANカード | Intel X550-AT2 10 Gigabit/2ポート/PCI-Ex4 | |

| IPMIマネジメントポート | [オンボード] IPMI Management LAN port (Realtek RTL8211FD-CG) | |

| I/O | USB 前面 | USB3.2 Gen1 x1ポート |

| USB 背面 | USB3.2 Gen1 x2ポート | |

| 映像出力 | VGA x1 (背面:1) | |

| その他 | RJ45(LAN)x2、IPMIx1、COMx1 | |

| 拡張スロット | (4) PCIe 5.0 x16 slots from CPU, support FHFL triple-wide GPU cards (2) PCIe 4.0 x16 slots (x8 signal) from CPU |

|

| ストレージ | (1) M.2 2280/22110 PCIe 3.0 x4 port (1) M.2 2280/22110 PCIe 3.0 x2 port |

|

| メモリスロット | 12 (空スロット×8) ※最大2TB | |

| 拡張ドライブベイ | (12) Hot-swap 2.5” U.2 PCIe 4.0 NVMe drive bays | |

| 動作温度範囲 | Operation temperature: 0℃ ~ 35℃ | |

| 電源ユニット | 3000W 80PLUS Platinum認証 冗長化電源(1+1) 1200 Watts (100V AC input) 2800W (200V AC input) 3000W (240V AC input) | |

| 外形寸法(約) | 約 438(W)×176(H)×831(D) mm 突起部は除く | |

| 保証 | [標準] 3年間センドバック方式ハードウェア保証 (保証コード:KI141125-12) | |