NVIDIA DGX B300

AI 推論を支える次世代 AI ファクトリー基盤。

企業の AI を新次元へ加速

NVIDIA DGX™ は、生成 AI の卓越した計算需要に応えるために設計された専用 AI インフラストラクチャ ソリューションです。NVIDIA Blackwell Ultra GPU を搭載した DGX B300 は、前世代と比べて推論性能が 11 倍、学習性能が 4 倍向上しており、すべてが最新のデータ センターにシームレスに適合するように設計された新しいフォーム ファクターを備えています。 NVIDIA MGX™ および従来のエンタープライズ ラック、フルスタック ソフトウェアと互換性があり、AI の導入を簡素化および合理化して、あらゆる企業がハイパースケーラーのように運用できるようにします。

推論時代を切り拓く AI ファクトリー

LLM 推論のためのリアルタイム・パワーハウス

Blackwell Ultra GPU を搭載した DGX B300 は、大規模言語モデル (LLM) のトレーニングと推論を加速する統合プラットフォームを企業に提供します。 192 ペタフロップス の推論性能により、あらゆる企業がハイパースケーラー級の運用環境を実現できます。

効率的で持続可能なイノベーション

複数の電力オプションを備えた DGX B300 は、類を見ないエネルギー効率とワットあたりの卓越した性能を実現する、最もエネルギー効率に優れた AI スーパーコンピューターとして設計されています。

革新的インフラストラクチャ スタンダードの創出

DGX B300 は最新のデータ センター向けに完全再設計され、初めて NVIDIA MGX ラックへの展開を可能にしました。 この新しい業界標準がデータ センター エンジニアリングに変革をもたらし、かつてないほど容易に画期的な性能と効率を実現します。

仕様

NVIDIA DGX B300 仕様詳細

| GPU | NVIDIA Blackwell Ultra GPUs |

| CPU | Intel® Xeon® 6776P プロセッサー |

| パフォーマンス | 72 PFLOPS FP8 学習 144 PFLOPS FP4 推論 |

| ネットワーキング | 8 つの OSFP ポートが 8 つの NVIDIA ConnectX-8 VPI にサービング >最大 800 Gb/秒の NVIDIA InfiniBand/Ethernet 2 x デュアル ポート QSFP112 NVIDIA BlueField-3 DPU >最大 400 Gb/秒の NVIDIA InfiniBand/Ethernet |

| 管理ネットワーク | RJ45 搭載の1GbE オンボード NIC 1GbE RJ45 ホスト ベースボード管理コントローラー (BMC) |

| ストレージ | OS:2x 1.9TB NVMe M.2 内部ストレージ: 8x 3.84TB NVMe E1.S |

| 消費電力 | ~14kW |

| ソフトウェア | NVIDIA DGX OS / NVIDIA Mission Control / NVIDIA AI Enterprise /NVIDIA Base Command Manager Supports Red Hat Enterprise Linux / Rocky / Ubuntu をサポート |

| サポート | ビジネス標準のハードウェアおよびソフトウェアの 3 年間のサポート |

現代のデータセンターのための設計図

DGX B300は、NVIDIA MGXラックに収まるように再設計されたシャーシを導入し、最新のデータセンターにおける互換性と拡張性を確保します。DGXB300 の空冷設計では、既存のデータセンターインフラストラクチャへの統合が容易になります。

顧客は初めて、バスバーと電源ユニット(PSU)のオプションを選択できる柔軟な電力アーキテクチャを利用できるようになり、既存のインフラと持続可能性の目標に最適なものを選択できるようになりました。この新しいDGX設計は、高速化されたコンピューティングインフラストラクチャの最適設計の設計図として機能し、AIインフラストラクチャを大規模に構築およびデプロイする柔軟な基盤を提供します。最先端の設計と実用的な保守性を組み合わせることで、DGX B300は、適応性と効率性に優れ、将来を見据えたAIインフラストラクチャの新たな基準を確立します。

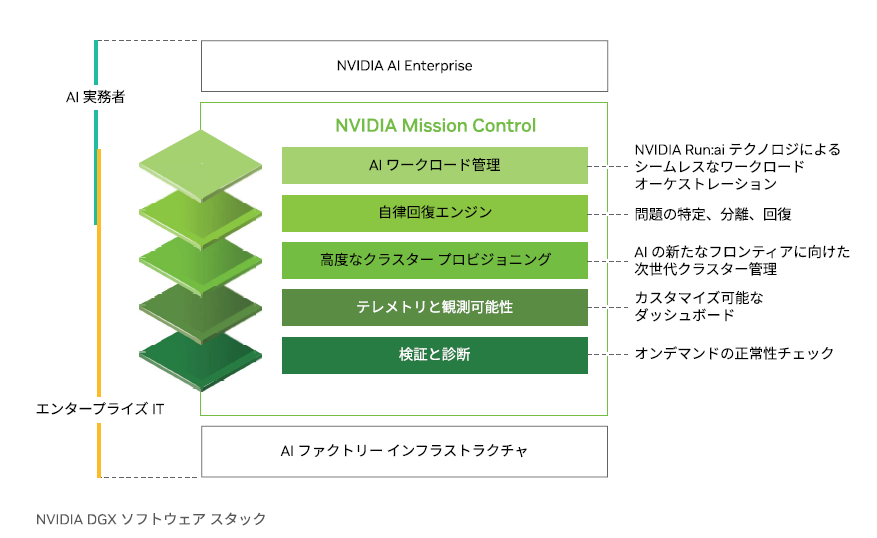

モデルを実行し、基本的なタスクを自動化するNVIDIA Mission Control

NVIDIA Mission Control は、世界最高水準の運用チームのスキルをソフトウェアとして提供し 開発者のワークロードからインフラ、施設に至るまで、AIファクトリー運用のあらゆる側面を強化します。推論とトレーニングに即時の俊敏性をもたらす一方で、インフラストラクチャの耐障害性にフルスタックのインテリジェンスを提供します。Mission Controlにより、あらゆる企業がハイパースケールの効率性でAIを実行できるようになり、AIの実験が加速します。さらに、NVIDIA AI Enterpriseは、AIの開発とデプロイを効率化するソフトウェアスイートを提供し、NVIDIA DGX システム上で実行するように最適化されています。NVIDIA NIMTM マイクロサービスを使用して最適なモデルのデプロイを行い、スピード、使いやすさ、管理性、セキュリティを提供します。