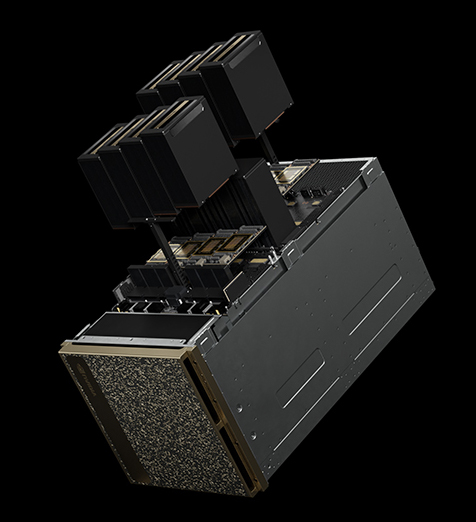

NVIDIA DGX B200

AI センター オブ エクセレンスの基盤

画期的なイノベーションに支えられる革新的な効率性

NVIDIA DGX™ B200 は、企業規模を問わず、AI 導入のどの段階においても、パイプラインの開発から導入までを可能にする統合 AI プラットフォームです。 第 5 世代の NVIDIA® NVLink® で相互接続された 8 基の NVIDIA B200 Tensor コア GPU を搭載した DGX B200 は、前世代と比較してトレーニング性能は 3 倍、推論性能は 15 倍の最先端の性能を提供します。NVIDIA Blackwell GPU アーキテクチャを採用した DGX B200 は、大規模言語モデル、レコメンダー システム、チャットボットなどの多様なワークロードを処理することができ、AI トランスフォーメーションの加速を目指す企業に最適です。

完全無欠な AI プラットフォーム

開発からデプロイまでのパイプラインのための 1 つのプラットフォーム

企業は、トレーニングからファインチューニングに推論まで、AI パイプラインのあらゆる段階で複雑な AI データセットを処理するために膨大な計算処理能力を必要とします。NVIDIA DGX B200 があれば、ワークフローを高速化するように作られた 1 つのプラットフォームを企業は開発者に与えることができます。

究極の AI パフォーマンス

NVIDIA Blackwell アーキテクチャの高度なコンピューティングを活用する DGX B200 は、DGX H100 と比較してそのトレーニング パフォーマンスが 3 倍、推論パフォーマンスが 25 倍となります。NVIDIA DGX BasePOD™ や NVIDIA DGX SuperPOD™ の土台である DGX B200 は、業界をリードするパフォーマンスをあらゆるワークロードに提供します。

実証済みのインフラストラクチャ標準

DGX B200 は、NVIDIA Base Command および NVIDIA AI Enterprise ソフトウェアを含む完全な NVIDIA AI ソフトウェア スタック、豊富なサードパーティ サポートのエコシステム、および NVIDIA プロフェッショナル サービスによる専門家のアドバイスへのアクセスを含む、完全に最適化されたハードウェアおよびソフトウェア プラットフォームです。

パフォーマンス

DGX B200 を活用した次世代のパフォーマンス

リアル タイム大規模言語モデル推論

予想されるパフォーマンスは変更される可能性があります。トークン間のレイテンシ (TTL) = 50ms リアルタイム、最初のトークンのレイテンシ (FTL) = 5ms、入力シーケンスの長さ = 32,768、出力シーケンスの長さ = 1,028、8x 8ウェイ HGX H100 GPU 空冷と 1x 8ウェイ DGX B200 空冷の比較、GPU あたりのパフォーマンス比較。

大幅に強化された AI トレーニング性能

予想されるパフォーマンスは変更される可能性があります。32,768 GPU スケール、4,096x 8ウェイ DGX H100 空冷クラスター: 400G IB ネットワーク、4,096x 8ウェイ DGX B200 空冷クラスター: 400G IB ネットワーク。

仕様

NVIDIA DGX B200 仕様詳細

| GPU | 8 基 の NVIDIA B200 Tensor コア GPU |

| GPU メモリ | 合計 1,440GB の GPU メモリ |

| パフォーマンス | 72 petaFLOPS の FP8 トレーニングと 144 petaFLOPS の FP4 推論 |

| 消費電力 | 最大 14.3kW |

| CPU | 2 個の Intel® Xeon® Platinum 8570 プロセッサ 合計 112 コア、2.1 GHz (ベース)、 4 GHz (最大ブースト) |

| システム メモリ | 最大 4TB |

| ネットワーキング | 4 基の OSFP ポートで 8 基のシングルポートを提供する NVIDIA ConnectX-7 VPI

|

| 管理ネットワーク | 10Gb/秒のオンボード NIC (RJ45 搭載) 100Gb/秒のデュアルポート イーサネット NIC ホスト BMC (ベースボード管理コントローラー、RJ45 搭載) |

| ストレージ | OS: 2 個の 1.9TB NVMe M.2 内部ストレージ: 8 個の 3.84TB NVMe U.2 |

| ソフトウェア | NVIDIA AI Enterprise: 最適化された AI ソフトウェア NVIDIA Base Command™: オーケストレーション、スケジューリング、クラスター管理 NVIDIA DGX OS / Ubuntu: オペレーティング システム |

| ラック ユニット (RU) | 10 RU |

| システム サイズ | 高さ: 17.5in (444mm) 幅: 19.0in (482.2mm) 長さ: 35.3in (897.1mm) |

| 運用温度 | 5–30°C (41–86°F) |

| 企業向けサポート | ハードウェアとソフトウェアの 3 年間のエンタープライズ Business-Standard サポート 年中無休のエンタープライズ サポート ポータル アクセス 現地営業時間中のライブ エージェント サポート |

関連情報

あらゆる企業に AI ファクトリーを提供

NVIDIA DGX SuperPOD

NVIDIA DGX SuperPOD™ は、あらゆるユーザーとワークロードに妥協のないパフォーマンスを提供するターンキー AI データセンター インフラ ソリューションです。あらゆる NVIDIA DGX システムで構成可能な DGX SuperPOD は、業界実証済みの結果を持つ、最も要求の厳しい AI トレーニングと推論ワークロードのためのスケーラブルなパフォーマンスを備えたリーダーシップクラスの高速インフラストラクチャを提供し、妥協のないパフォーマンスを実現します。

NVIDIA DGX プラットフォームの価値を最大化

NVIDIA エンタープライズ サービスは、NVIDIA DGX インフラ向けにサポート、教育、プロフェッショナル サービスを提供します。AI 導入のあらゆる段階を支援できる NVIDIA エキスパートにより、エンタープライズ サービスはお客様のプロジェクトを迅速かつ確実に立ち上げ、実行するお手伝いをします。

NVIDIA DGX のお客様限定トレーニング特典を受け取る

NVIDIA Deep Learning Institute (DLI) の AI エキスパートが、NVIDIA DGX のお客様限定で特別に提供するこの技術トレーニングでは、AI で最先端のブレークスルーをより速く達成する方法を学びます。